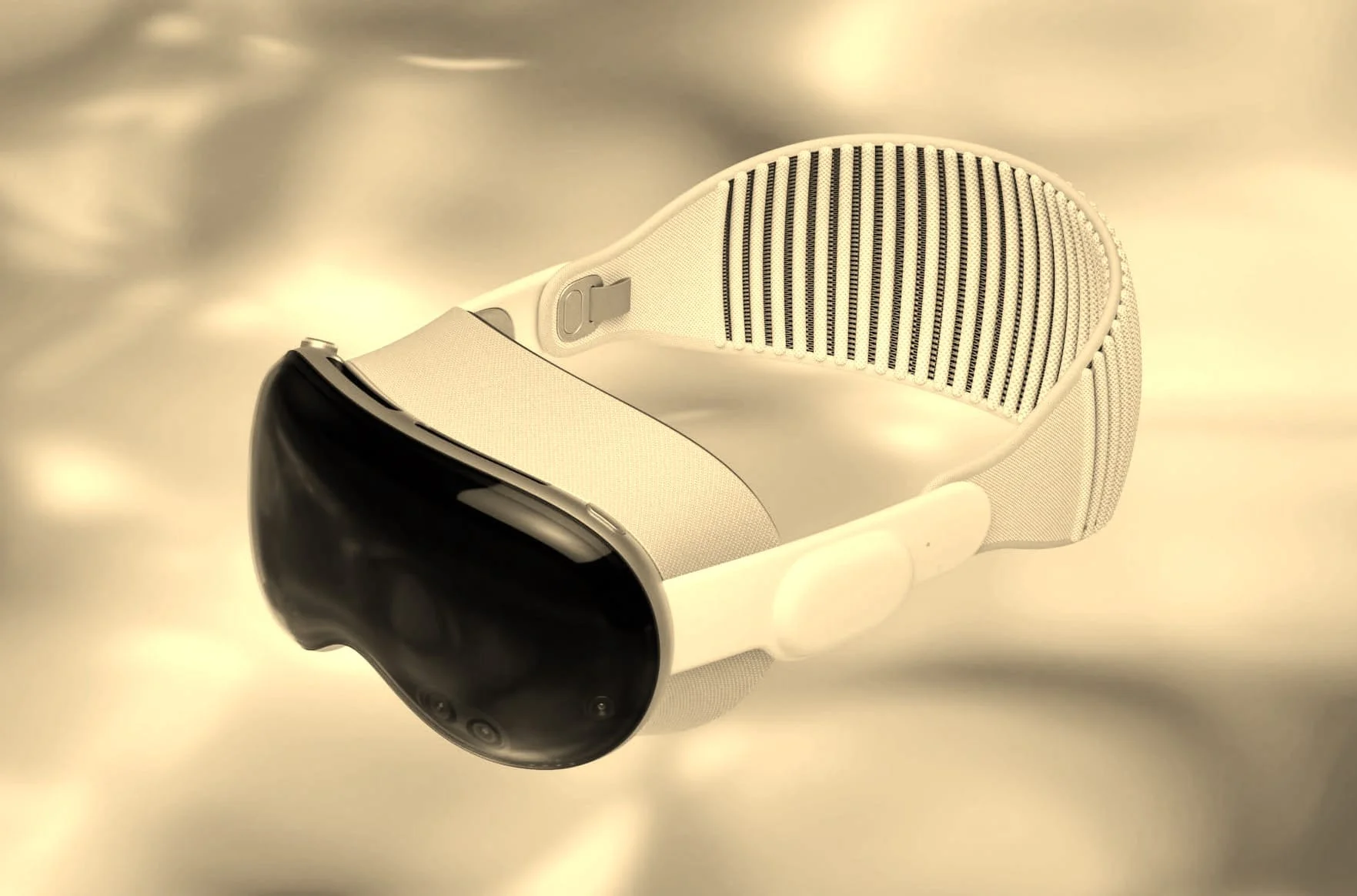

Als Apple die Vision Pro erstmals vorstellte, war ich unglaublich begeistert. Das Potenzial der Plattform schien grenzenlos, und als Entwickler wirkte es wie eine neue Welt, die es zu erkunden galt. Ich bin sofort voll eingestiegen und sah eine seltene Chance für Experimente und Innovation. Nachdem ich jedoch einige Apps veröffentlicht und intensiv mit visionOS gearbeitet hatte, wurde mir klar, dass ich auf Einschränkungen stieß, die es so nicht geben sollte.

Ich hatte mehrere einzigartige App-Ideen, aber mir fehlten die APIs, die diese Konzepte überhaupt erst umsetzbar gemacht hätten. Ich hätte mehr Apps veröffentlicht, wenn visionOS die nötigen Werkzeuge für die AR/VR-Erlebnisse geliefert hätte, die das Gerät verspricht. Es geht mir dabei nicht um eine offenere Plattform wie macOS – ich verstehe den Wert der Sicherheit und Einfachheit im iOS/iPadOS-Ökosystem. Doch visionOS fühlt sich an wie iPadOS mit anderen Eingabemethoden. Was fehlt, sind einzigartige APIs, die speziell dafür entwickelt wurden, die immersiven Erlebnisse voll auszuschöpfen, die die Vision Pro bieten kann.

Hier sind die fünf APIs, die meiner Meinung nach visionOS von einem vielversprechenden Experiment in eine Plattform verwandeln könnten, für die es sich wirklich lohnt zu entwickeln:

1. Magnetisches Anheften von Fenstern und Objekten an Oberflächen

Foto von Kristyna Squared.one / Unsplash

Foto von Kristyna Squared.one / Unsplash

Stell dir vor, du könntest Fenster oder 3D-Objekte an Wänden oder Möbeln in einem Raum anheften – dauerhaft. Dieses Feature würde es Nutzern ermöglichen, persistente Setups in ihrer Umgebung zu erstellen, und Entwicklern die Möglichkeit geben, die Anheftungsfunktion je nach Kontext ihres Erlebnisses ein- und auszuschalten. Zum Beispiel würde meine Posters-App dann endlich Sinn ergeben! Noch wichtiger: Diese angehefteten Objekte sollten auch nach einem Systemneustart an Ort und Stelle bleiben, ähnlich wie Desktop-Umgebungen oder Fokusmodi. Diese Funktionalität sollte sich auch über verschiedene Nutzer hinweg erstrecken – beim Wechsel in den Gastmodus sollten alle angehefteten Elemente genau dort bleiben, wo sie platziert wurden.

Derzeit fühlt sich die Erweiterung der Realität auf der Vision Pro vorübergehend an, weil diese API fehlt, was sie eher zu einem reinen VR-Gerät macht – und ich glaube nicht, dass das Apples Vision für die Plattform ist. Diese Einschränkung begrenzt das volle Potenzial von Mixed-Reality-Erlebnissen, da Nutzer sich nicht darauf verlassen können, dass ihre digitalen Objekte an ihrem Platz im physischen Raum bleiben. Die Möglichkeit, Fenster und Objekte magnetisch anzuheften, ist daher die wichtigste API, die nötig ist, um die Vision Pro über ein VR-Erlebnis hinauszuheben und ihr wahres Mixed-Reality-Potenzial zu verwirklichen.

2. Erweitertes Raum-Scanning mit editierbaren 3D-Modellen

Foto von Dynamic Wang / Unsplash

Foto von Dynamic Wang / Unsplash

Eine hybride API, die die Leistung von RoomPlan und dem auf iOS verfügbaren 3D-Scanner kombiniert, könnte die Möglichkeiten von Entwicklern zur Erstellung immersiver Inhalte revolutionieren. Während das Scannen eines Raums derzeit möglich ist, fehlt die nötige Tiefe für vollständig interaktive Räume. Der nächste Schritt sollte es ermöglichen, nicht nur die Abmessungen, sondern auch die Farben und Texturen zu erfassen, um hochdetaillierte 3D-Modelle zu erzeugen.

Warum sind diese Scanning-APIs nicht auf der Apple Vision Pro verfügbar? Sie benötigen einen LiDAR-Sensor, den die Vision Pro hat. Die Erstellung auf der Vision Pro wäre komfortabler und würde es Nutzern ermöglichen, die Ergebnisse sofort in 3D zu sehen. Idealerweise könnte Apple auch eine App für Entwickler bereitstellen, um diese Umgebungen direkt in der Vision Pro mit Handgesten zu bearbeiten. Wenn ich zum Beispiel einen Tisch verschiebe und den Raum erneut scanne, sollte das System die Änderung erkennen und den Tisch als bewegliches Objekt behandeln. Apples KI-Tools könnten Lücken mit realistischen Texturen und Objekten füllen, die 3D-Umgebungserstellung intuitiver machen und den Bedarf an komplexen CAD-Tools reduzieren.

3. Eine Skelett-Erkennungs-API für spaßige AR-Interaktionen

Eine meiner liebsten App-Ideen beinhaltete die Erkennung von Körperteilen mithilfe von Apples AR-Frameworks, um ein bisschen Die Sims in die reale Welt zu bringen. Stell dir vor, du gehst herum und siehst einen schwebenden grünen Diamanten (wie den Plumbob aus den Sims) über jeder Person, der es dir ermöglicht, auf einzigartige und spielerische Weise mit ihnen zu interagieren. Um das möglich zu machen, wäre eine einfache Skelett-Tracking-API ein Gamechanger, die es Entwicklern ermöglichen würde, Körperbewegungen und Gesten zu erkennen. Selbst eine grobe Schätzung der Kopfposition oder Armbewegung könnte Features wie interaktive Sprechblasen ermöglichen, basierend auf dem, was jemand sagt oder fühlt. Fortgeschrittene APIs könnten Gesichtsausdrücke erkennen und so die Möglichkeit für schwebende Emotions-Icons oder Interaktionsvorschläge schaffen, ähnlich wie in Die Sims.

Ich verstehe, dass Apple keinen vollen Kamerazugriff gewähren möchte – und ehrlich gesagt würde ich die Vision Pro auch nicht nutzen, wenn sie es täten. Da die Kamera aber bereits an ist, könnte das System erkannte Weltinformationen teilen, die die Privatsphäre der Nutzer respektieren und gleichzeitig solche Erlebnisse ermöglichen. Es gibt noch viel ungenutztes Potenzial, das AR-Interaktionen deutlich verbessern könnte.

4. Interaktive räumliche 360°- und 180°-Videoelemente

Während die Vision Pro immersive Video-Erlebnisse verspricht, ist es derzeit unmöglich, interaktive Buttons oder Objekte in diese räumlichen 180°/360°-Videos zu integrieren. Entwickler sollten in der Lage sein, klickbare Elemente im Raum zu platzieren, während man sich in einem Video befindet – stell dir interaktive Touren oder geführte Erlebnisse vor, bei denen Nutzer auf Objekte klicken können, um mehr Informationen zu erhalten oder zwischen Videos zu wechseln, die verschiedene Zeiten oder Perspektiven zeigen.

Dieses Feature könnte es Nutzern auch ermöglichen, innerhalb eines Ortes zu „Zeitreisen”, indem sie nahtlos zwischen Videoaufnahmen desselben Ortes zu verschiedenen Zeiten wechseln. Derzeit erfordern solche Interaktionen das mühsame Erstellen von 3D-Umgebungen von Grund auf. Eine einfache API zum Platzieren interaktiver Elemente in Videos würde den Prozess enorm vereinfachen und endlose Möglichkeiten für interaktives Storytelling, Bildungstools und mehr eröffnen. Aktuell ist viel Aufwand nötig, um auch nur annähernd ein solches Erlebnis zu schaffen, einschließlich des Baus eines eigenen Videoplayers in RealityKit mit verschiedenen Bildern für jedes Auge. Solche Hacks sollten nicht nötig sein.

5. Die Welt entdecken: Die Zukunft von Apple Maps

Foto von Jezael Melgoza / Unsplash

Foto von Jezael Melgoza / Unsplash

Eine der überraschendsten Lücken in visionOS ist das Fehlen einer nativen Maps-App, die für die Vision Pro optimiert ist. Während Umsehen auf anderen Geräten immersive Straßenansichten bietet, könnte die Vision Pro dieses Erlebnis auf ein neues Level heben, indem Nutzer direkt in 3D-Umgebungen versetzt werden, in denen sie in Echtzeit mit ihrer Umgebung interagieren können. Apples KI-Technologie, die Fotos in 3D-Szenen verwandelt, könnte genutzt werden, um die bestehenden Umsehen-Bilder in interaktive Umgebungen umzuwandeln und neue Möglichkeiten für immersive, standortbasierte Apps zu erschließen.

Eine richtige Vision Pro Maps-API könnte dieses Erlebnis komplett verändern. Stell dir vor, du gehst (oder besser gesagt beamst dich) durch eine Stadt und interagierst mit virtuellen Objekten, die an bestimmte Orte gebunden sind – sei es für ein Spiel, zu Bildungszwecken oder sogar einen immersiven Reiseplaner. Entwickler könnten Erlebnisse schaffen, bei denen Nutzer durch historische Rekonstruktionen navigieren, zukünftige Stadtpläne erkunden oder mit dynamischen Inhalten interagieren, während sie durch die Straßen streifen.

Der Schlüssel zum Erfolg der Vision Pro

Foto von Razvan Chisu / Unsplash

Foto von Razvan Chisu / Unsplash

Das sind genau die Art von APIs, die nicht nur Entwickler wie mich bei visionOS halten würden, sondern auch die Erstellung immersiverer und fesselnderer Inhalte vorantreiben würden. Im Moment fehlen der Vision Pro die Killer-Apps, die Nutzer zum Kauf bewegen, und ohne genügend Nutzer zögern Entwickler, signifikant Zeit in die Plattform zu investieren. Es ist ein Kreislauf, der durchbrochen werden muss, und die Lösung liegt auf der Hand – Apple muss die Inhaltserstellung für Entwickler so einfach wie möglich machen.

Ich verlange kein offenes System oder realitätsferne Features – ich verlange APIs, die das echte Potenzial der Vision Pro für Entwickler und Nutzer gleichermaßen entfesseln können. Ohne sie ist es schwer zu sehen, wie die Plattform die nötige Dynamik gewinnen soll. Aber wenn Apple auch nur einige dieser APIs einführt, wäre ich sofort bereit, wieder einzusteigen und Apps zu bauen, die die Grenzen von AR und VR verschieben könnten – und die Vision Pro letztlich zu dem bahnbrechenden Gerät machen, das sie sein sollte.

Foto von

Foto von