AppleがVision Proを初めて発表したとき、私は本当にワクワクしました。プラットフォームの可能性は無限に感じられ、開発者として新しいフロンティアを探索できるように思えました。すぐに飛び込み、実験とイノベーションのまたとないチャンスだと捉えました。しかし、いくつかのアプリをリリースし、visionOSでの開発を重ねるうちに、本来あるべきでない制限に直面していることに気づきました。

ユニークなアプリのアイデアはいくつもありましたが、それらのコンセプトを実現するために必要なAPIが不足していて、制約を感じていました。visionOSがそのデバイスが約束するAR/VR体験を作るために必要なツールを提供していれば、もっと多くのアプリをリリースしていたでしょう。これはmacOSのようなオープンなプラットフォームを求めているわけではありません。iOS/iPadOSエコシステムのセキュリティとシンプルさの価値は理解しています。しかし、visionOSは入力方法が異なるだけのiPadOSのように感じられます。欠けているのは、Vision Proが提供できる没入体験をフルに活用するために設計された独自のAPIです。

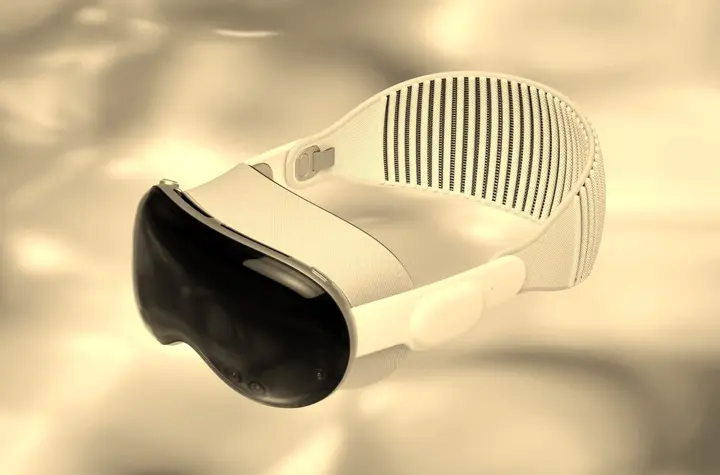

ここでは、visionOSを有望な実験段階から、本当に開発する価値のあるプラットフォームに変えられると信じる5つのAPIを紹介します:

1. ウィンドウやオブジェクトを表面に磁石のように固定する機能

写真: Kristyna Squared.one / Unsplash

写真: Kristyna Squared.one / Unsplash

部屋の壁や家具にウィンドウや3Dオブジェクトを永続的に固定できることを想像してみてください。この機能があれば、ユーザーは自分の環境に永続的なセットアップを作成でき、開発者は体験のコンテキストに応じて固定機能を切り替えられるようになります。たとえば、私のPostersアプリがようやく本来の意味を持つようになるでしょう!さらに重要なのは、これらの固定されたオブジェクトがシステムの再起動後も元の位置に残ること。デスクトップ環境や集中モードと同様です。また、ユーザーの切り替えにも対応すべきです。ゲストモードに切り替えても、固定されたアイテムはすべてそのままの場所にあるべきです。

現在のVision Proでは、このAPIがないため現実の拡張が一時的なものに感じられ、VR専用デバイスに近い印象になっています。これはAppleのプラットフォームビジョンとは一致していないと思います。この制限が複合現実体験の真のポテンシャルを制約しており、ユーザーはデジタルオブジェクトが物理空間に留まることを信頼できません。したがって、ウィンドウやオブジェクトを磁石のように固定する機能は、Vision ProをVR体験の枠を超えて真の複合現実のポテンシャルを実現するために最も重要なAPIです。

2. 編集可能な3Dモデルを伴う高度なルームスキャン

写真: Dynamic Wang / Unsplash

写真: Dynamic Wang / Unsplash

RoomPlanのパワーとiOSで利用可能な3Dスキャナーを組み合わせたハイブリッドAPIがあれば、没入コンテンツを作成する開発者の能力を革新できるでしょう。部屋のスキャン自体は現在も可能ですが、完全にインタラクティブな空間を実現するには深さが足りません。次のステップでは、寸法だけでなく色やテクスチャもキャプチャし、高精細な3Dモデルを生成できるようにすべきです。

なぜこれらのスキャンAPIがApple Vision Proで利用できないのでしょうか? LiDARセンサーが必要ですが、Vision Proには搭載されています。Vision Pro上で3Dモデルを作成すれば、結果をすぐに3Dで確認できてより快適でしょう。理想的には、Appleが開発者向けにVision Pro上でハンドジェスチャーを使って環境を直接編集できるアプリを提供してくれることです。たとえば、テーブルを移動して部屋を再スキャンすると、システムがその変更を認識してテーブルを移動可能なオブジェクトとして扱うべきです。AppleのAIツールがリアルなテクスチャやオブジェクトでギャップを埋められれば、3D環境の作成がより直感的になり、複雑なCADツールの必要性も減ります。

3. 楽しいARインタラクションのための骨格認識API

私のお気に入りのアプリアイデアの1つは、AppleのARフレームワークを使った体の部位検出で、「ザ・シムズ」の要素を現実世界に持ち込むものでした。歩き回っていると各人の頭上にシムズのプランボブのような緑色のダイヤモンドが浮かんでいて、ユニークで遊び心のある方法でインタラクションできることを想像してみてください。これを実現するには、身体の動きやジェスチャーを認識できるシンプルな骨格トラッキングAPIがあれば画期的です。頭の位置や腕の動きの大まかな推定だけでも、誰かが話している内容や感情に基づいたインタラクティブな吹き出しなどの機能が実現できます。高度なAPIでは表情を検出し、浮遊する感情アイコンや「ザ・シムズ」のようなインタラクション提案を作り出す可能性もあります。

Appleがカメラへの完全なアクセスを提供したくないのは理解できますし、正直なところ、提供されたら私はVision Proを使わないでしょう。しかし、カメラはすでにオンになっているのですから、ユーザーのプライバシーを尊重しつつ、検出されたワールド情報をシステムが共有できるはずです。このような体験を可能にする、まだ活用されていないポテンシャルが多く残っています。

4. インタラクティブな空間360度・180度ビデオ要素

Vision Proは没入型ビデオ体験を約束していますが、現在のところ空間180度/360度ビデオにインタラクティブなボタンやオブジェクトを統合することはできません。開発者はビデオの中にいながら空間にクリック可能な要素を配置できるべきです。インタラクティブなツアーやガイド体験で、ユーザーがオブジェクトをクリックして詳細情報を取得したり、異なる時間や視点のビデオに切り替えたりできることを想像してみてください。

この機能を使えば、同じ場所の異なる時間の映像を切り替えることで、ロケーション内で「タイムトラベル」することも可能になります。現在、このようなインタラクションを実現するには、3D環境をゼロから入念に構築する必要があります。ビデオ内にインタラクティブ要素を配置するシンプルなAPIがあれば、プロセスが大幅に簡略化され、インタラクティブなストーリーテリング、教育ツールなどの無限の可能性が開かれるでしょう。現状では、このような体験に近づくためには多大な労力が必要で、RealityKit内でそれぞれの目に異なる画像を表示するカスタムビデオプレーヤーの構築も含まれます。このようなハックは本来不要であるべきです。

5. 世界を探索する:Apple Mapsの未来

写真: Jezael Melgoza / Unsplash

写真: Jezael Melgoza / Unsplash

visionOSで最も意外な欠落の1つが、Vision Pro向けに最適化されたネイティブのマップアプリがないことです。「Look Around」は他のデバイスでストリートレベルの没入ビューを提供していますが、Vision Proでは3D環境にユーザーを直接配置し、リアルタイムで周囲とインタラクションできるようにすることで、この体験をさらに高められるはずです。写真を3Dシーンに変換するAppleのAI技術を使って、「Look Around」の既存の画像をインタラクティブな環境に変換すれば、没入型のロケーションベースアプリの新たな可能性が開かれます。

適切なVision Pro Maps APIがあれば、この体験を根本的に変えられるでしょう。都市の中を歩き回り(というよりテレポートし)、特定の場所に紐づいた仮想オブジェクトとインタラクションすることを想像してみてください。ゲーム、教育目的、あるいは没入型トラベルプランナーとしても活用できます。開発者は、歴史的な再現をナビゲートしたり、未来の都市計画を探索したり、街を歩きながらダイナミックなコンテンツと触れ合ったりする体験を作り出せるでしょう。

Vision Pro成功のカギ

写真: Razvan Chisu / Unsplash

写真: Razvan Chisu / Unsplash

これらは、私のような開発者をvisionOSに引き留めるだけでなく、より没入的で魅力的なコンテンツの創出を促進するAPIです。現在のVision Proには、ユーザーが購入したくなるようなキラーアプリが不足しており、ユーザーが十分にいなければ開発者もプラットフォームに多くの時間を投資することをためらいます。この循環を断ち切る必要があり、その解決策は明確です。Appleが開発者にとってコンテンツ制作をできるだけ簡単にすることです。

オープンなシステムや非現実的な機能を求めているのではありません。Vision Proの真のポテンシャルを開発者とユーザー双方のために解き放つAPIを求めているのです。それがなければ、このプラットフォームが必要な勢いを得るのは難しいでしょう。しかし、AppleがこれらのうちいくつかのAPIでも導入してくれれば、私はすぐに戻ってARとVRの限界を押し広げるアプリを開発する準備ができています。そうすることで、Vision Proは本来あるべきブレイクスルーデバイスになれるはずです。

写真:

写真: